Podcast Deep Dive ins Thema. Erstellt mit KI.

Wie Künstliche Intelligenz unsere Arbeitswelt verändert

Die Geschwindigkeit, mit der künstliche Intelligenz (KI) die Arbeitswelt transformiert, ist atemberaubend. Seit November 2022, als ChatGPT erstmals der breiten Öffentlichkeit zugänglich gemacht wurde, hat sich die Dynamik rund um KI rasant verstärkt. Doch der Begriff „künstliche Intelligenz“ kann leicht täuschen: Die aktuellen Tools sind keine denkenden Wesen. Sie basieren auf großen Sprachmodellen, die gewaltige Datenmengen analysieren, Muster erkennen und plausible Antworten generieren – ohne Bewusstsein, Intelligenz oder echtes Verstehen. Und dennoch haben diese Technologien die Art, wie wir arbeiten, bereits nachhaltig verändert.

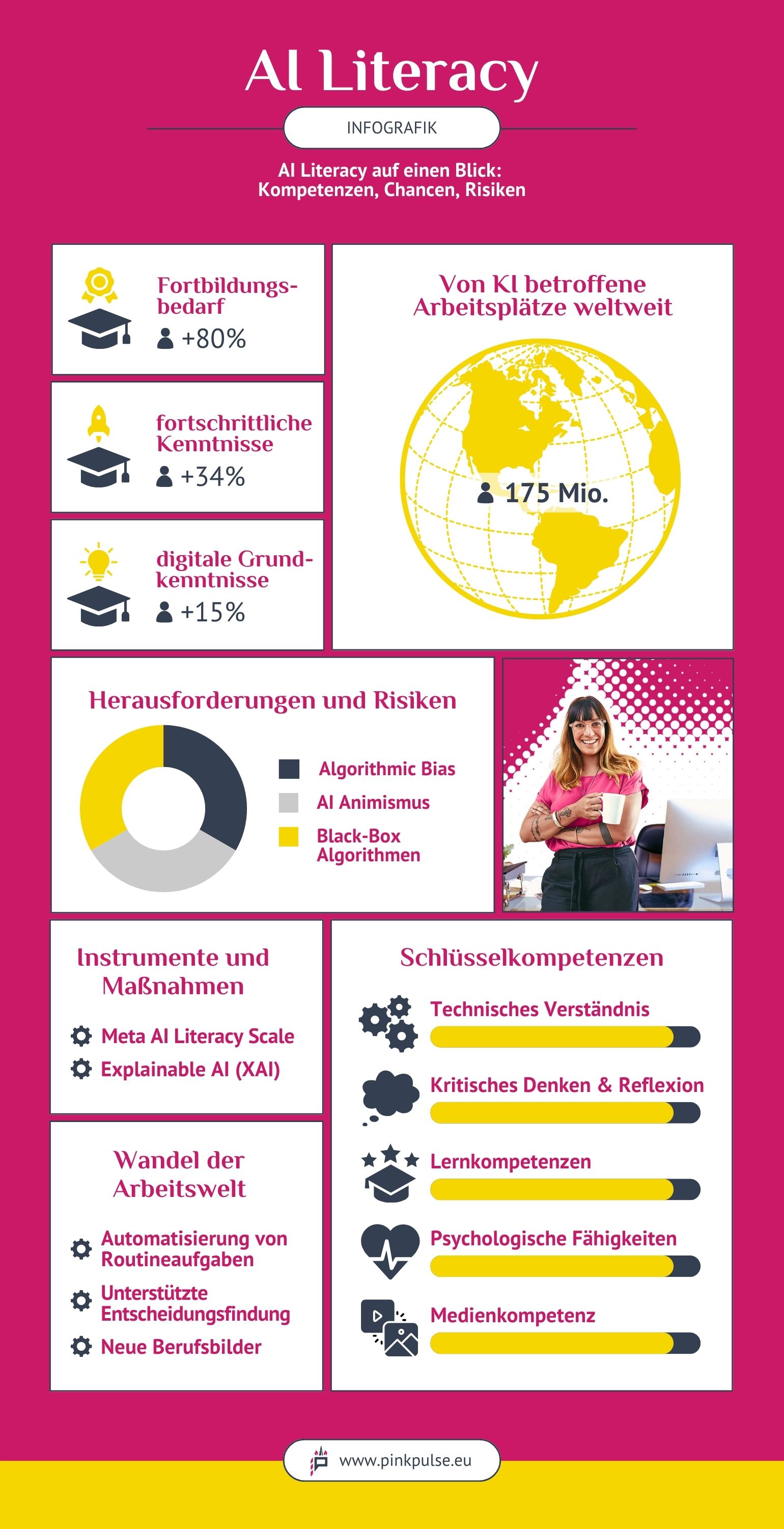

Die McKinsey-Studie "A new future of work: The race to deploy AI and raise skills in Europe and beyond" (Eric Hazan, et al., 2024 ) unterstreicht diese rasante Entwicklung. In den nächsten fünf Jahren könnten rund 375 Millionen Arbeitsplätze weltweit durch KI-gestützte Technologien verändert werden. KI eröffnet damit neue Möglichkeiten, von effizienteren Prozessen bis hin zu völlig neuen Berufsbildern. Damit verbunden sind ebenso völlig neue Herausforderungen.

Die Fähigkeit, mit KI zu interagieren, sie kritisch zu hinterfragen und sinnvoll einzusetzen – AI Literacy – wird zur Schlüsselqualifikation. Es geht nicht nur darum, diese Technologien zu beherrschen, sondern auch ihre Auswirkungen zu verstehen und ethisch verantwortungsvoll zu handeln.

KI transformiert viele Arbeitsplätze. Auch Menschen, die bisher wenig technische Berührungspunkte hatten, werden über kurz oder lang mit KI zusammenarbeiten.

Erste Fragen liegen auf der Hand: Wie können wir sicherstellen, dass Mitarbeitende die grundlegenden Mechanismen von KI-Systemen verstehen? Welche Kompetenzen brauchen wir, um KI nicht nur zu nutzen, sondern auch kritisch zu hinterfragen? AI Literacy ist der Schlüssel, um die Chancen von KI zu nutzen, ihre Risiken zu minimieren und sich aktiv an einer technologischen Zukunft zu beteiligen.

Digital Native reicht nicht mehr: AI Literacy erklärt

Du scrollst mühelos durch Social Media, organisierst dein Leben über Apps und surfst im Netz, als hättest du es erfunden – willkommen in der Welt der Digital Natives. Als jemand, der mit Smartphones und schnellem Internet aufgewachsen ist, bist du bestens im digitalen Alltag zu Hause. Aber reicht das, um in einer Arbeitswelt zu bestehen, die von künstlicher Intelligenz (KI) geprägt wird?

Stell dir vor, Literacy (Kompetenz) ist ein Werkzeugkoffer, den du brauchst, um in der digitalen Welt zu arbeiten. Digital Literacy ist darin der Hammer – ein solides Werkzeug, mit dem du die grundlegenden Aufgaben erledigst: recherchieren, schreiben, digitale Tools bedienen. Aber was, wenn du plötzlich vor einer komplexen Maschine stehst, die dir Arbeit abnehmen, Entscheidungen treffen und Daten analysieren soll? Genau hier kommt AI Literacy ins Spiel. Sie ist die Aufbauanleitung im Werkzeugkoffer – die Fähigkeit, die komplexen Zusammenhänge zu verstehen, Fehler zu erkennen und diese Maschine sicher zu nutzen.

Definition und Abgrenzung zur Digital Literacy

Digital Literacy beschreibt die grundlegenden Kompetenzen, die du benötigst, um dich im digitalen Raum sicher zu bewegen. Dazu gehören der Umgang mit Computern, die Nutzung des Internets und die Fähigkeit, Informationen kritisch zu bewerten. Es geht darum, digitale Werkzeuge effektiv einzusetzen – ob bei der Recherche, in der Kommunikation oder in sozialen Netzwerken.

Die wichtigsten Fertigkeiten umfassen:

- Informationskompetenz

- Fähigkeit, Informationen im Internet und in digitalen Medien zu suchen, zu finden und kritisch zu bewerten

- Beurteilung der Glaubwürdigkeit und Qualität von Informationsquellen

- Technische Fähigkeiten

- Nutzung von Webbrowsern, Suchmaschinen, E-Mail und verschiedener Software

- Umgang mit digitalen Geräten wie Smartphones und Notebooks

- Kommunikation und Zusammenarbeit

- Angemessene Kommunikation in digitalen Umgebungen

- Nutzung von Tools für kooperative Prozesse

- Gestaltung der eigenen digitalen Präsenz und Identität

- Inhaltserstellung und -bearbeitung

- Kreative Nutzung digitaler Medien zur Erstellung und Bearbeitung von Inhalten

- Verständnis für Urheberrechte und Lizenzen

- Sicherheit und Privatsphäre

- Schutz persönlicher Daten und der eigenen Privatsphäre in sozialen Netzwerken

- Verwendung sicherer Passwörter und Schutz des eigenen Computers

- Kritisches Denken und Medienkompetenz

- Erkennen von Einseitigkeit und unabhängige Bewertung von Medienbotschaften

- Verständnis für die Funktionsweisen digitaler Technologien

- Sozio-emotionale Kompetenz

- Umgang mit sozialen und emotionalen Aspekten im Online-Raum

- Verantwortungsbewusste Nutzung digitaler Medien und Technologie

Wenn du beispielsweise einen LinkedIn-Post über ein aktuelles Projekt vorbereitest, wirst du relevante Inhalte recherchieren, eine ansprechende Grafik in Canva gestalten und die ideale Posting-Zeit planen. Genau hier wird Digital Literacy sichtbar: Sie hilft dir, Informationen zu finden, diese zu verarbeiten und gezielt zu kommunizieren.

Digitale Kompetenz ist eine Voraussetzung für KI-Kompetenz, da Individuen verstehen müssen, wie man Computer nutzt, um KI zu verstehen.

Digital literacy is a prerequisite for AI literacy, as individuals need to understand how to use computers to make sense of AI.

Du scrollst durch deinen LinkedIn-Feed und bemerkst, dass dir genau die Inhalte angezeigt werden, die dich interessieren. Doch warum erscheinen bestimmte Beiträge oben und andere nicht?

Hier stößt Digital Literacy an ihre Grenzen. Diese Kompetenz hilft dir, Social Media zu nutzen, aber sie erklärt dir nicht, wie Algorithmen funktionieren. Dein Verhalten auf der Plattform – was du likst, kommentierst oder suchst – wird von KI analysiert. Diese Algorithmen entscheiden, welche Inhalte für dich priorisiert werden.

Ohne ein Verständnis für KI bleibst du in einer Filterblase gefangen. Du siehst die Ergebnisse, ohne die Prozesse dahinter zu verstehen. Um diese Mechanismen zu durchschauen, braucht es mehr als digitale Kompetenz. Genau hier setzt AI Literacy an – die Fähigkeit, KI-Prozesse zu verstehen und bewusst mit ihnen umzugehen.

Anwendungsgebiete der Digital Literacy

- Bedienung von Computern

- Internetnutzung

- Social Media Nutzung

- Digitale Informationssuche und -bewertung

Die Schlüsselrolle von AI Literacy in der modernen Arbeitswelt

Die Anforderungen an digitale Fähigkeiten entwickeln sich rasant weiter. Laut der McKinsey-Studie wird die Nachfrage nach grundlegenden IT-Kenntnissen bis 2030 um 15% steigen, da nahezu jede berufliche Rolle digitale Kompetenzen voraussetzt. Doch digitale Grundkenntnisse allein reichen nicht aus: Die Nachfrage nach fortgeschrittenen Fähigkeiten wie Datenanalyse und wissenschaftlicher Forschung wird sogar um 34% zunehmen (Eric Hazan, et al., 2024 ). Digital Literacy ermöglicht den sicheren Umgang mit digitalen Tools, doch in einer Arbeitswelt, die zunehmend von KI geprägt ist, braucht es mehr: AI Literacy. Diese Schlüsselkompetenz befähigt dich, KI-Systeme zu verstehen, ihre Entscheidungen kritisch zu bewerten und sie verantwortungsvoll in den Arbeitsalltag zu integrieren.

Ein praxisbezogener Blick auf Social Media zeigt, wie tief KI bereits in unseren Alltag eingreift – und welche Risiken es birgt, sie nicht zu verstehen. Öffnest du deinen Feed, erscheinen Inhalte, die genau auf deine Interessen zugeschnitten scheinen. Das ist kein Zufall: Hinter deinem Feed stehen KI-Algorithmen, die dein Verhalten analysieren – von den Beiträgen, die du likst, bis zu den Videos, die du ansiehst. Ihr Ziel ist klar: Dich so lange wie möglich auf der Plattform zu halten. Die Algorithmen gehen dabei weit über einfache Vorlieben hinaus. Sie analysieren Muster, erkennen Trends in deinen Interaktionen und nutzen diese Daten, um dir noch gezielter Inhalte und Werbung anzuzeigen.

Du siehst, KI ist längst mehr als ein Werkzeug – sie gestaltet Arbeitsprozesse und trifft Entscheidungen, die dich beeinflussen. Ohne AI Literacy bleibt vieles unverständlich.

- Kritisches Denken und Bewertung: Mitarbeitende mit AI Literacy können die Ergebnisse von KI-gestützten Systemen bewerten und mögliche Verzerrungen (z. B. algorithmischer Bias) erkennen. Ob im HR, wo Algorithmen Bewerbungen filtern, im Marketing, wo Zielgruppen analysiert werden, oder im Managment, wo KI unterstützte Marktanalysen wichtig sind – die Fähigkeit, Daten kritisch zu prüfen, ist unverzichtbar.

- Ethische Verantwortung: KI-Systeme haben enorme Auswirkungen auf Fairness und Transparenz in Unternehmen. AI Literacy befähigt dich, ethische Fragestellungen zu reflektieren und faire Entscheidungen zu fördern.

Nicht alle Menschen begegnen KI mit Neugier. Viele empfinden Unsicherheit oder sogar Angst im Umgang mit KI – ein Phänomen, das als AI Anxiety bekannt ist. Um diese Kompetenzen zu fördern, wurde die Meta AI Literacy Scale entwickelt – ein wissenschaftlich fundiertes Messinstrument, das Unternehmen und Beschäftigten hilft, Kompetenzlücken zu erkennen und Weiterbildungsmaßnahmen gezielt zu planen. (Observatorium Künstliche Intelligenz in Arbeit und Gesellschaft, 2024 ) Unternehmen profitieren von einem klaren Überblick über die Stärken und Schwächen ihrer Mitarbeitenden und können gezielte Fortbildungsangebote entwickeln, um die Einführung von KI zu unterstützen.

KI transformiert viele Arbeitsplätze. Auch Menschen, die bisher wenig technische Berührungspunkte hatten, werden über kurz oder lang mit KI zusammenarbeiten.

Künstliche Intelligenz (KI) verändert die Arbeitswelt in einem Ausmaß, das nicht ignoriert werden kann. Laut Matt Beane, Assistant Professor im Bereich Technologiemanagement an der University of California, müssen etwa 80% der Belegschaft neue Aufgaben erlernen. (Dan Turchin, 2024 [Podcast] ) Dabei geht es nicht nur um die Einführung neuer Werkzeuge oder Technologien. Beane betont, dass die Neugestaltung von Arbeitsabläufen weitreichender ist: Sie erfordert ein tiefgreifendes Umdenken von Rollen und Aufgaben.

- Automatisierung von Routineaufgaben: Denk an den täglichen Papierkram, das Einpflegen von Daten oder das Sortieren von E-Mails.KI übernimmt diese repetitiven Aufgaben.

- Erhöhung der Effizienz: Fehler passieren, vor allem bei manuellen Prozessen – ein Zahlendreher hier, ein falsch gesetzter Punkt da. KI kann helfen, diese Stolperfallen zu minimieren und Prozesse zuverlässiger zu machen.

- Unterstützung bei komplexer Entscheidungsfindung: Stell dir vor, du hast tausende Seiten voller Daten, aber keine Zeit, sie zu durchforsten. Hier kommt die KI ins Spiel. Ob Markttrends oder prädiktive Analysen – KI kann dir dabei helfen, Muster zu erkennen und wichtige Erkenntnisse herauszufiltern.

- Verbesserung der Zusammenarbeit: In verteilten Teams entstehen oft Kommunikationsprobleme oder Missverständnisse. KI-Tools können hier unterstützen – etwa durch intelligentes Aufgabenmanagement, bessere Synchronisation von Informationen sowie sprachliche und kulturelle Übersetzungen.

Unternehmen stehen in der Verantwortung, diesen Wandel aktiv zu gestalten. Zielgerichtete Investitionen in Weiterqualifizierung und Umschulung sind notwendig, um Mitarbeitende auf Berufe vorzubereiten, die höhere Anforderungen und komplexere Aufgaben mit sich bringen.

Anwendungsgebiete der AI Literacy

- Contentgenerierung mit KI (Texte, Übersetzungen, Medien)

- Automatisierung von Coding und Debugging

- Predictive Maintenance und Qualitätskontrolle in der Industrie

- Datenanalyse und prädiktive Entscheidungsfindung

Die versteckten Risiken

Künstliche Intelligenz (KI) beeindruckt durch ihre Effizienz und Präzision. Doch was passiert, wenn die Grundlage ihrer Entscheidungen – die Daten und Algorithmen – fehlerhaft oder voreingenommen sind? Zwei zentrale Risiken stehen dabei im Fokus: Algorithmic Bias, der zeigt, wie Vorurteile und Ungleichheiten durch KI verstärkt werden können, und AI Animismus, der beschreibt, wie wir Maschinen unbegründet menschliche Eigenschaften zuschreiben.

Während algorithmische Verzerrungen zu unfairen und oft diskriminierenden Ergebnissen führen können, verleitet uns die vermeintlich „menschliche“ Interaktion mit KI-Systemen dazu, ihre Fähigkeiten zu überschätzen und ihre Grenzen nicht kritisch zu hinterfragen. Dieses Kapitel zeigt, wie diese versteckten Risiken entstehen, welche Folgen sie haben und welche Schritte nötig sind, um KI verantwortungsvoll einzusetzen.

Algorithmic Bias: Die KI ist niemals neutral

Algorithmen sind keine neutralen Entscheidungswerkzeuge: Sie tragen die Vorurteile ihrer Entwicklerinnen und Entwickler in sich. Sie basieren auf den Daten, mit denen sie trainiert wurden. Dieses Phänomen wird als algorithmische Verzerrung oder Algorithmic Bias bezeichnet.

Stell dir vor, ein Unternehmen nutzt KI, um Bewerbungen für eine Führungsposition zu sichten. Der Algorithmus wurde mit historischen Daten trainiert, die Informationen wie Alter, Geschlecht, Wohnort und den bisherigen beruflichen Erfolg früherer Mitarbeiterinnen und Mitarbeiter enthalten. Bereits bei der Auswahl dieser Daten spielen menschliche Entscheidungen eine zentrale Rolle: Welche Merkmale werden einbezogen? Welche Daten bleiben unberücksichtigt? Es ist der menschliche Faktor – die Entwicklerinnen und Entwickler, die die KI füttern und trainieren –, der maßgeblich beeinflusst, welche Muster die KI lernt.

Ein genauer Blick auf die Hauptursachen zeigt, warum algorithmische Verzerrung so schwer zu vermeiden ist.

- Voreingenommene Trainingsdaten:

Historische Daten spiegeln oft bestehende Ungleichheiten wider. Wenn diese Daten ungefiltert in die KI-Modelle einfließen, reproduziert der Algorithmus die gleichen Verzerrungen. - Unzureichende Datenrepräsentation:

Wenn bestimmte Personengruppen, in den Daten unterrepräsentiert sind, wird der Algorithmus ihre Perspektiven und Qualifikationen systematisch vernachlässigen. - Korrelationsverzerrung:

Algorithmen erkennen Korrelationen, die keine kausalen Zusammenhänge haben. Zum Beispiel wird aus dem Wohnort einer Bewerberin fälschlicherweise auf ihre Eignung geschlossen, ohne ihre tatsächlichen Fähigkeiten zu berücksichtigen. - Feedback-Schleifen:

Systeme, die verzerrte Ergebnisse für die weitere Entscheidungsfindung nutzen, erzeugen eine Feedback-Schleife. So werden die Verzerrungen immer weiter verstärkt. - Subjektive Programmierentscheidungen:

Entwicklerinnen und Entwickler treffen bewusst oder unbewusst Entscheidungen, die bestimmte Merkmale bevorzugen oder benachteiligen. So können etwa Gewichtungen von Faktoren wie Geschlecht oder Erfahrung die Ergebnisse verzerren.

In unserem Beispiel gewichtet die KI männliche Bewerber, die in der Nähe der Firma wohnen stärker, da historische Daten diese Personen in Führungspositionen überrepräsentieren. Das Ergebnis? Hochqualifizierte Kandidatinnen und Bewerbungen aus ferneren Regionen werden übersehen, obwohl sie alle erforderlichen Kompetenzen mitbringen.

Für Unternehmen hat dies weitreichende Konsequenzen: Sie übersehen Talente und das Vertrauen in den Bewerbungsprozess beschädigt – sowohl intern als auch extern. Wenn solche Verzerrungen nicht erkannt und korrigiert werden, verstärken sie sich durch die fortlaufende Nutzung des Algorithmus.

KI-Algorithmen lernen, Entscheidungen auf der Grundlage der Daten zu treffen, mit denen sie trainiert wurden. Wenn diese Daten unverhältnismäßig, unvollständig oder historisch oder kulturell voreingenommen sind, wird der Algorithmus diese Voreingenommenheit replizieren und potenziell verstärken.

Oft bleibt unklar, warum ein Algorithmus bestimmte Entscheidungen trifft – und genau hier beginnt das Problem der sogenannten Black Box. Black-Box-Algorithmen stehen sinnbildlich für die Herausforderungen moderner KI-Systeme: Ihre internen Abläufe – von der Datenverarbeitung bis zur Entscheidungsfindung – bleiben undurchschaubar. Ihre Intransparenz macht es schwierig, Verzerrungen zu erkennen oder Fehlerquellen im Algorithmus zu identifizieren. Sie analysieren riesige Datenmengen und generieren Ergebnisse, ohne dass klar ist, welche Faktoren wie stark in die Entscheidungen einfließen.

Explainable AI (XAI) bietet Ansätze, um die Intransparenz von Black-Box-Algorithmen zu durchbrechen. Dabei zeigt XAI auf, welche Eingabedaten und Faktoren die größte Rolle gespielt haben, etwa ob im Bewerbungsprozess Merkmale wie Geschlecht oder Wohnort die Bewertung beeinflusst haben. XAI nutzt dazu visuelle Darstellungen wie Entscheidungsbäume oder Gewichtungen, die erklären, wie der Algorithmus zu seinem Ergebnis gekommen ist. Dies hilft, Verzerrungen zu erkennen und zu korrigieren.

Risiken durch Algorithmic Bias

- Diskriminierung und Benachteiligung Betroffener

- Reputationsschäden und juristische Folgen für Unternehmen

- Verlust der Glaubwürdigkeit für das KI Tool

AI Animismus: Menschliche Eigenschaften in KI sehen

Es gibt einen guten Grund, warum KI durch die Einführung eines Chats in Form von ChatGPT 2022 einen so durchschlagenden Erfolg hatte. Plötzlich fühlte sich die Interaktion mit einer Maschine wie ein echtes Gespräch an: mühelos, natürlich – und überraschend unterhaltsam. Warum ist das so?

Stell dir vor, du nutzt einen virtuellen Assistenten, der mit dir spricht, als wäre er dein engster Kollege: freundlich, empathisch und immer mit einem scheinbar perfekten Verständnis für deine Wünsche. Er reagiert auf deine beruflichen Herausforderungen und scheint diese gut zu verstehen. Klingt beeindruckend, oder? Doch was wie Magie wirkt, ist nichts anderes als das Zusammenspiel komplexer Algorithmen – und deinem eigenen Gehirn.

AI Animismus beschreibt unsere Neigung, KI-Systemen menschliche Eigenschaften wie Intelligenz, Emotionen und Absichten zuzuschreiben. Diese Vermenschlichung geschieht unbewusst und ist tief in unseren kognitiven Mustern verwurzelt. Schon ein sympathisch formulierter Satz wie „Ich verstehe, dass das frustrierend ist“ reicht aus, um uns glauben zu lassen, wir hätten es mit einem empathischen Gegenüber zu tun.

Menschen neigen dazu, menschliche soziale Kategorien wie Geschlecht und ethnische Zugehörigkeit überzustrapazieren und diese auf Computer anzuwenden.

People tend to overuse human social categories, such as gender and ethnicity, by applying them to computers.

Menschen neigen dazu, selbst in unbelebten Objekten wie Spielzeugen, Werkzeugen oder Computern menschliche Züge zu erkennen. Wir tendieren dazu, ihnen ein Geschlecht und einen kulturellen Kontext zu geben. Deine liebste Kaffeemaschine heißt Vittorio. Sie ist also männlich, italienisch und ganz offenbar das kompetenteste Wesen auf dieser Welt, um einen guten Espresso zu machen. Na, ertappt?

Bei KI-Systemen wird diese Tendenz gezielt verstärkt: Natürliche Sprache, imitierte Emotionen oder menschlich klingende Stimmen sind darauf programmiert, unsere sozialen Bedürfnisse zu bedienen.

Die Psychologie nennt dieses Phänomen Ethopoeia. Anders als Anthropomorphismus ist Ethopoeia keine bewusste Entscheidung, sondern eine unbewusste Reaktion. Wir fühlen, dass die Maschine „menschlich“ ist, selbst wenn wir rational wissen, dass sie es nicht ist. Das führt zu einer vertrauten Verbindung – die jedoch trügerisch sein kann.

Menschen können durch KI-Hinweise leicht in die Irre geführt werden und glauben, mit empfindungsfähigen Wesen zu interagieren, wodurch sie erlernte Normen und Skripte anwenden.

Humans can be easily misled by AI cues, led to believe that they are interacting with sentient beings, thereby applying learned norms and scripts.

Diese unbewussten Prozesse schaffen die Grundlage für ein gefährliches Phänomen, das Psychologinnen und Psychologen als „Mindlessness“ bezeichnen: Wir hinterfragen nicht mehr, was die KI tatsächlich kann. Die freundliche Stimme, die scheinbar perfekt formulierten Antworten – all das erzeugt eine vertraute Verbindung, die uns dazu verleitet die technischen Grenzen der KI ignorieren und ihre Fähigkeiten zu überschätzen. Sie wird nicht als Maschine wahrgenommen, die Code abspult – sondern als empathischer Partner. Statt nachzufragen, ob die Antwort korrekt oder sinnvoll ist, vertrauen wir ihr blind.

Elemente, die uns zur Vermenschlichung verleiten

- Natürliche Sprache und Stimme

- Empathische Reaktionen, Humor und Emotionale Signale

- Personalisierung

- Konsistenz

- Kontextbewusstsein

- Nutzung von Geschichten und Anektoten

Essenzielle Kompetenzen im Detail

AI Literacy bedeutet weit mehr, als ein paar Prompts zu formulieren. Wer Künstliche Intelligenz wirklich verstehen und verantwortungsvoll nutzen will, muss tiefer gehen. Nur wer die technischen Grundlagen – wie Algorithmen, Datenquellen oder Entscheidungswege von KI-Systemen – kennt, kann durchschauen, wie KI funktioniert, und erkennen, wo ihre Grenzen liegen.

Doch damit ist es nicht getan. Eine reflektierte Nutzung von KI erfordert die Fähigkeit, Ergebnisse einzuordnen und kritisch zu hinterfragen. Das bedeutet auch, mögliche Fehler in den zugrunde liegenden Daten zu erkennen, ihre Auswirkungen zu verstehen und die richtigen Schlüsse daraus zu ziehen.

Gleichzeitig verlangt der Umgang mit KI ständige Lernbereitschaft – denn das, was heute neu ist, kann morgen schon überholt sein.

Diese Kompetenzen sind der Schlüssel, um nicht nur passiv mit KI zu arbeiten, sondern sie aktiv und bewusst zu nutzen. Jeder dieser Aspekte öffnet eine Tür in eine Welt, in der Wissen, Verantwortung und Medienkompetenz mehr zählen denn je. Bist du bereit, diese Reise anzutreten?

Technisches Verständnis

Künstliche Intelligenz basiert darauf, riesige Datenmengen zu analysieren, Muster zu erkennen und auf dieser Basis Entscheidungen zu treffen. Dabei nutzen KI-Systeme Algorithmen, die eigenständig lernen können, indem sie ihre Ergebnisse an neue Daten anpassen – ein Prinzip, das als maschinelles Lernen bekannt ist.

- Grundlagen der KI-Mechanismen verstehen: KI basiert auf Algorithmen, die keine Kausalitäten verstehen, sondern auf Datenkorrelationen beruhen. Sie verwendet dazu statistische Modelle und Wahrscheinlichkeiten, um Vorhersagen zu treffen oder Entscheidungen zu fällen. Ein Verständnis dieser Prozesse zeigt, dass KI keine Magie ist, sondern Mathematik und Informatik in Aktion.

- Black-Box-Systeme erkennen: Viele KI-Modelle – insbesondere neuronale Netze – arbeiten in einer „Black-Box“-Struktur, bei der die genauen Entscheidungswege und Logiken undurchsichtig bleiben. Zu wissen, dass KI nicht immer nachvollziehbar ist, hilft, ihre Ergebnisse nicht blind zu akzeptieren.

- Erklärbare KI nutzen: Ansätze wie „Explainable AI“ (XAI) bieten Möglichkeiten, die Entscheidungsprozesse von KI-Systemen transparenter zu machen, indem sie visuelle Darstellungen oder logisch nachvollziehbare Erklärungen liefern. Solche Modelle ermöglichen es, Verzerrungen zu erkennen und fundierte Entscheidungen zu treffen.

Ein technisches Verständnis der KI ermöglicht es dir, ihre Entscheidungen kritisch zu hinterfragen und fundierte Entscheidungen darüber zu treffen, wie du sie einsetzt. In der Praxis bedeutet das: Überprüfe immer, welche Daten ein KI-System verwendet und ob es sich um verlässliche Quellen handelt. Achte darauf, ob Erklärungen für die Ergebnisse verfügbar sind, und nutze KI-Tools, die Transparenz bieten.

Kritisches Denken und Reflexion

KI ist nicht neutral: Sie spiegelt die Daten wider, mit denen sie trainiert wurde, und diese Daten enthalten oft Verzerrungen. Kritisches Denken ist daher essenziell, um die Ergebnisse einer KI zu hinterfragen und ihre potenziellen Fehler zu erkennen. Ohne diese Fähigkeit besteht die Gefahr, dass wir Fehlinformationen übernehmen, ohne sie zu prüfen.

- Algorithmische Verzerrung erkennen: KI trifft Entscheidungen auf Basis ihrer Trainingsdaten und der Informationen, die sie in der Nutzungsphase erhält. Verzerrte oder unvollständige Trainingsdaten können bestehende gesellschaftliche Ungleichheiten widerspiegeln und verstärken. Kritisches Denken hilft, solche Muster zu erkennen und deren Auswirkungen zu minimieren.

- Filterblasen verstehen: KI-Systeme wie Suchmaschinen oder soziale Medien personalisieren Inhalte. Dies kann dazu führen, dass Nutzerinnen und Nutzer immer wieder ähnliche Informationen sehen und sich in einer Filterblase einseitiger Perspektiven bewegen. Ein Bewusstsein für diesen Effekt ermöglicht es, aktiv nach vielfältigen Informationen zu suchen.

- Halluzinationen bei KI erkennen: KI kann Inhalte generieren, die überzeugend erscheinen, aber völlig falsch sind – ein Phänomen, das als „Halluzination“ bezeichnet wird. Dies tritt häufig bei generativen Modellen auf, wenn fehlende Daten durch plausible, aber erfundene Inhalte ersetzt werden. Kritisches Denken hilft, solche Fehler zu hinterfragen, zusätzliche Quellen zu konsultieren und die Informationen unabhängig zu überprüfen.

Kritisches Denken und Reflexion befähigen dich, die Ergebnisse von KI nicht als absolute Wahrheit zu akzeptieren, sondern sie bewusst zu prüfen. In der Praxis bedeutet das, bei wichtigen Entscheidungen die Quellen der Daten zu hinterfragen, alternative Informationsquellen zu nutzen und Ergebnisse mit Fact-Checking-Tools abzusichern. Achte darauf, Filterblasen zu umgehen, indem du aktiv nach konträren Meinungen suchst. Um Halluzinationen zu erkennen, frage eine KI gezielt nach ihren Datenquellen oder überprüfe die Aussagen mithilfe vertrauenswürdiger Informationsplattformen.

Lernkompetenzen

Verleitet vom Hype rund um die künstliche Intelligenz laufen erste Unternehmen Gefahr, dass Mitarbeitende in einer „Plug-and-Play“-Mentalität nur auf ihre Funktionalität reduziert werden – austauschbar und ohne Raum für individuelle Stärken oder Entwicklung. Doch wer langfristig erfolgreich sein will, muss auf das Potenzial seiner Teams setzen. Lernprogramme sollten nicht isoliert betrachtet werden, sondern immer im Kontext des größeren Systems stehen, in das die Aufgaben eingebettet sind. Diese Perspektive stärkt nicht nur die Resilienz der Belegschaft, sondern bildet auch die Grundlage für ein modernes und zukunftsorientiertes Wissensmanagement.

- Skills Curiosity entwickeln: Neugier ist nicht nur ein persönliches Asset, sondern kann durch gezielte Organisationsmaßnahmen gefördert werden. Sie ermöglicht es Mitarbeitenden, neue Technologien wie KI nicht nur zu verstehen, sondern aktiv nach kreativen Anwendungsmöglichkeiten zu suchen. Führungskräfte spielen hier eine zentrale Rolle, indem sie Lernräume schaffen.

- Reskilling und Upskilling fördern: Während Reskilling (Umschungen) Mitarbeitende auf komplett neue Aufgaben vorbereitet, zielt Upskilling (Weiterbildung) darauf ab, bestehende Kompetenzen zu erweitern und vertiefen. Beide Ansätze sind unverzichtbar, um Teams auf die dynamischen Anforderungen der Arbeitswelt vorzubereiten.

Unternehmen, die Skills Curiosity fördern und in laufende Qualifizierung investieren, machen den Unterschied zwischen einem starren und einem agilen Organisationskulturen. In der Praxis bedeutet das, Neugier gezielt zu fördern, etwa durch interaktive Lernformate, Workshops oder Hackathons. Reskilling und Upskilling können durch maßgeschneiderte Programme und den Einsatz von adaptiven Lernplattformen effektiv umgesetzt werden. So bleiben Mitarbeitende nicht nur kompetent, sondern treiben Innovation aktiv voran und sichern gleichzeitig die Zukunftsfähigkeit ihrer Organisation.

Psychologische Fähigkeiten

Künstliche Intelligenz ist so gestaltet, dass sie menschliches Verhalten imitiert – von empathischen Reaktionen bis hin zu vertrauter Sprache. Genau diese Eigenschaften verleiten uns dazu, unkritisch mit KI-Systemen zu interagieren. Menschen regieren dabei oft widersprüchlich: Obwohl sie wissen, dass KI keine echten Emotionen besitzt, vertrauen sie ihr dennoch wie einem menschlichen Gegenüber. Diese Tendenz birgt das Risiko, dass wir die Grenzen der Technologie übersehen und langfristig sogar unser eigenes Verhalten und unsere Entscheidungsfähigkeit beeinflusst sehen.

- Umgang mit Mindlessness: Mindlessness beschreibt die unkritische, Nutzung von KI-Systemen, bei der Menschen ihre Entscheidungen unbewusst an Maschinen delegieren. Es ist wichtig, die eigene Denkweise zu hinterfragen und bewusste Entscheidungen zu treffen, anstatt sich von der scheinbaren Menschlichkeit von KI täuschen zu lassen. Strategien wie regelmäßige Reflexion, Trainings zur kritischen Analyse von KI-Ausgaben und Teamdiskussionen können helfen, das Bewusstsein für eigene Denkmuster zu schärfen.

- Emotionale Intelligenz stärken: Emotionale Intelligenz ist die Fähigkeit, eigene Emotionen und die von anderen zu erkennen und angemessen darauf zu reagieren. Im Kontext von KI bedeutet dies, die emotionalen Trigger zu verstehen, die von Maschinen ausgehen können – etwa durch empathisch klingende Antworten – und zu lernen, sich davon nicht manipulieren zu lassen. Schulungen können Nutzer dabei unterstützen, Manipulationen zu erkennen und souverän mit diesen Effekten umzugehen.

Psychologische Fähigkeiten wie der bewusste Umgang mit Mindlessness und emotionale Intelligenz sind essenziell, um den Einfluss von KI bewusst zu steuern. In der Praxis bedeutet das, sich regelmäßig selbst zu hinterfragen: „Verlasse ich mich gerade blind auf die KI?“ Trainingsprogramme können helfen, die eigene Wahrnehmung zu schärfen und Manipulationen besser zu erkennen. Zusätzlich stärkt ein regelmäßiger Austausch im Team das Bewusstsein für emotionale und psychologische Aspekte im Umgang mit Technologie.

Medienkompetenz

Die Digitalisierung hat unser Konsumverhalten grundlegend verändert. Künstliche Intelligenz (KI) beschleunigt diesen Wandel weiter, indem sie Inhalte erstellt, personalisiert und verbreitet. Diese Entwicklung birgt enorme Chancen, stellt uns aber auch vor neue Herausforderungen: Medieninhalte kritisch zu hinterfragen, KI-generierten Content zu erkennen und die eigenen Daten aktiv zu schützen, wird immer wichtiger. Medienkompetenz ist und bleibt somit eine Schlüsselkompetenz, um sich sicher und souverän in der digitalen Welt zu bewegen.

- KI-generierten Content erkennen: KI-Tools können täuschend echte Bilder, Videos und Texte erstellen, die immer schwerer von echten Inhalten zu unterscheiden sind. Es ist wichtig, Merkmale von KI-generierten Inhalten – wie inkonsistente Details, Durchschnittlichkeit oder fehlende Quellen – zu erkennen und deren Glaubwürdigkeit kritisch zu prüfen.

- Fake News hinterfragen: KI kann die Verbreitung von Fake News verstärken, indem sie personalisierte Desinformationen erstellt. Kritisches Denken und die Fähigkeit, Inhalte auf ihre Fakten zu überprüfen, sind essenziell, um zwischen Wahrheit und Manipulation zu unterscheiden.

- Datenschutz aktiv gestalten: Nutzerinnen und Nutzer sollten lernen, welche Daten sie teilen und wie sie ihre Privatsphäre schützen können. Dazu gehört, Datenschutzrichtlinien zu verstehen, die Nutzung von Tracking-Tools zu minimieren und sichere Plattformen zu bevorzugen.

Medienkompetenz befähigt Nutzerinnen und Nutzer, sich sicher und kritisch in der digitalen Welt zu bewegen. Plattformen zur Überprüfung von Inhalten, wie Fact-Checking-Websites, können helfen, die Glaubwürdigkeit von Informationen zu prüfen. Zudem ist es wichtig, sich aktiv mit Schutz persönlicher Daten und den eigenen Datenspuren im Internet auseinanderzusetzen. In einer zunehmend KI-geprägten Medienlandschaft wird ist Medienkompetenz entscheidend, um informierte Entscheidungen zu treffen und manipulative Einflüsse zu vermeiden.

Fazit: AI Literacy als Schlüssel zum beruflichen Erfolg

Künstliche Intelligenz hat die Arbeitswelt tiefgreifend verändert. Werkzeuge wie ChatGPT, MidJourney und firmeneigene KI-Lösungen sind längst im beruflichen Alltag angekommen. Sie automatisieren Aufgaben, unterstützen bei Entscheidungen und schaffen neue Berufsfelder. Doch diese Entwicklungen erfordern weit mehr als die reine Bedienung digitaler Werkzeuge: AI Literacy wird zur entscheidenden Kompetenz, um in einer zunehmend KI-geprägten Arbeitswelt nicht nur zu bestehen, sondern aktiv mitzuwirken.

AI Literacy bedeutet, die Funktionsweise und Grenzen von KI zu verstehen, algorithmische Verzerrungen zu erkennen und die Auswirkungen von KI-Entscheidungen kritisch zu bewerten. Sie ermöglicht es, die Potenziale von KI für Innovation und Effizienz voll auszuschöpfen, ohne dabei die Risiken wie Manipulation, Filterblasen oder den Verlust der Datenhoheit aus dem Blick zu verlieren. Nur wer KI-Systeme reflektiert hinterfragt und verantwortungsvoll einsetzt, kann sicherstellen, dass diese Technologien als Werkzeuge des Fortschritts dienen – und nicht als Quelle neuer Ungerechtigkeiten.

In Arbeitswelt ist AI Literacy nicht nur eine individuelle Qualifikation, sondern eine gesamtgesellschaftliche Verantwortung. Unternehmen, die in die Kompetenzen ihrer Mitarbeitenden investieren, legen den Grundstein für nachhaltige Innovation und ethisches Handeln. Für Einzelpersonen bietet AI Literacy die Möglichkeit, sich in einer technisierten Welt selbstbestimmt zu bewegen, beruflich erfolgreich zu sein und Teil einer zukunftsfähigen Arbeitskultur zu werden.

FAQ

- AI Literacy ermöglicht es, KI-Systeme effektiv zu nutzen, Entscheidungen kritisch zu bewerten und ihre Auswirkungen zu verstehen. Gefragt sind Kompetenzen wie technisches Verständnis, ethisches Handeln und kritisches Denken. Nur wer KI reflektiert einsetzt, kann Chancen wie Effizienzsteigerung nutzen und Risiken wie algorithmische Verzerrungen minimieren.

- AI Literacy vereint technisches Wissen (z. B. Datenanalyse), kritisches Denken und ethische Verantwortung. Sie befähigt, KI-Entscheidungen zu hinterfragen, algorithmische Verzerrungen zu erkennen und Technologien sinnvoll einzusetzen. Medienkompetenz und psychologische Fähigkeiten ergänzen diese Kompetenz, um Manipulation und Filterblasen zu vermeiden.

- Zentrale Risiken sind Algorithmic Bias, der Vorurteile verstärkt, und AI Animismus, der uns verleitet, KI-Systemen menschliche Eigenschaften zuzuschreiben. Diese können zu unkritischem Vertrauen oder diskriminierenden Ergebnissen führen. AI Literacy hilft, diese Gefahren zu erkennen und KI verantwortungsvoll zu nutzen.

Lexikon

AI Literacy (KI Kompetenz)

Im Kontext der KI bedeutet Literacy die Fähigkeit, die Grundprinzipien künstlicher Intelligenz zu verstehen und kritisch über ihre Anwendung und ihre Auswirkungen auf die Gesellschaft nachzudenken. Es umfasst das Wissen, wie KI-Systeme funktionieren, wie sie trainiert werden, und ein Bewusstsein für ihre potenziellen Verzerrungen und ethischen Implikationen

Algorithmic Bias (Algorithmische Verzerrung)

Dies bezieht sich auf systematische und unfaire Verzerrungen in den Ergebnissen von Algorithmen, besonders von KI-Systemen. Solche Verzerrungen können aufgrund von voreingenommenen Trainingsdaten, Entwicklungspraktiken oder Entscheidungskriterien entstehen und führen dazu, dass bestimmte Gruppen von Menschen ungerecht behandelt werden.

Anthropomorphismus

Anthropomorphismus bezeichnet die bewusste Zuschreibung menschlicher Eigenschaften, Gefühle oder Absichten an nicht-menschliche Systeme. Dies kann die Akzeptanz und Interaktion erleichtern, aber auch zu unrealistischen Erwartungen an KI führen.

Black-Box-Algorithmen

Black-Box-Algorithmen sind KI-Systeme, deren innere Funktionsweise für Nutzer nicht transparent ist. Sie erschweren das Verständnis und die Nachvollziehbarkeit von Entscheidungen. Explainable AI (erklärbare KI) fördert hier mehr Transparenz, um Vertrauen zu stärken und Fehleinschätzungen zu vermeiden.

Digital Literacy (Digitale Kompetenz)

Die Fähigkeit, digitale Technologien sicher, kritisch und kreativ zu nutzen, wird als Digital Literacy (Digitale Kompetenz) bezeichnet. Sie umfasst Medienkompetenz, Datenschutz, Informationsbewertung, Problemlösung und die verantwortungsbewusste Nutzung digitaler Inhalte, um effektiv in einer vernetzten Welt zu kommunizieren, zu lernen und zu arbeiten.

Ethopoeia

Ethopoeia beschreibt die unbewusste Projektion menschlicher Eigenschaften auf KI-Systeme. Im Gegensatz zu Anthropomorphismus geschieht dies reflexartig, ohne bewusste Reflexion darüber, ob diese Zuschreibungen gerechtfertigt sind.

Feedback Loop (Rückkopplungsschleife)

Ein Feedback Loop entsteht, wenn Ergebnisse eines KI-Systems als neue Eingabedaten verwendet werden. Dies kann Fehler oder Verzerrungen verstärken und führt oft zu einer sich selbst verstärkenden Dynamik, die schwer zu durchbrechen ist.

Filter Bubble (Filterblase)

Filterblasen entstehen durch Algorithmen, die Inhalte auf Basis von Nutzerpräferenzen priorisieren. Dadurch werden abweichende Meinungen ausgeschlossen, was die Wahrnehmung verzerrt und einseitige Weltbilder begünstigt. Kritisches Medienverständnis hilft, solche Dynamiken zu erkennen.

Halluzinationen

Halluzinationen bezeichnen falsche oder erfundene Inhalte, die von Generativen KI-Systemen erzeugt werden. Diese entstehen, wenn die KI unzureichende oder missverständliche Prompts erhält. Sie stellen ein Risiko dar, da Nutzer:innen die fehlerhaften Ergebnisse oft nicht sofort als solche erkennen können.

KI-Animismus

Ein Konzept, das die Tendenz beschreibt, künstlichen Intelligenzen oder Robotern menschenähnliche Eigenschaften, Bewusstsein oder Emotionen zuzuschreiben. KI-Animismus kann die Art und Weise beeinflussen, wie Menschen mit KI-Systemen interagieren und über sie denken, und wirft Fragen bezüglich unserer Beziehung zu Technologie und den Grenzen künstlicher Intelligenz auf.

KI-Mechanismus

Im Gegensatz zum KI-Animismus betont der KI-Mechanismus die Auffassung von KI-Systemen als komplexe, aber letztlich mechanische und nicht-bewusste Werkzeuge, die zur Erreichung menschlicher Ziele eingesetzt werden. Diese Perspektive konzentriert sich auf die technischen und funktionalen Aspekte von KI, ohne ihr menschenähnliche Qualitäten zuzuschreiben.

Korrelationsverzerrung

Korrelationsverzerrung tritt auf, wenn Algorithmen fälschlich kausale Zusammenhänge aus Daten ableiten, die lediglich korrelieren. Solche Fehler können zu fehlerhaften Entscheidungen führen und erfordern eine genaue Prüfung der Dateninterpretation.

Mindlessness

Mindlessness beschreibt unbewusstes Verhalten, bei dem Menschen soziale Konzepte anwenden, die für zwischenmenschliche Interaktionen gedacht sind, jedoch unkritisch auf Computer oder KI übertragen werden. Dieses Verhalten zeigt, dass Nutzer oft ohne tiefergehende Reflexion auf technologische Reize reagieren.

Skills Curiosity

Skills Curiosity beschreibt die proaktive Haltung, eigene Fähigkeiten zu hinterfragen und gezielt weiterzuentwickeln. Sie fördert Anpassungsfähigkeit in technologischen Disruptionen, stärkt persönliche Kompetenzen und erleichtert Innovationen in dynamischen Arbeitswelten.

Quellen

Augustin, Yannik; Markus, André; Wienrich, Carolin. (2023). Digital interaction literacy model – Conceptualizing competencies for literate interactions with voice-based AI systems. In: Computers and Education: Artificial Intelligence, 4, 100114.

Carolus, Astrid; Wienrich, Carolin; Törke, Anna; Friedel, Tobias; Schwietering, Christian; Sperzel, Mareike. (2021). ‘Alexa, I feel for you!’ Observers’ Empathetic Reactions towards a Conversational Agent. In: Frontiers in Computer Science, 3, 682982.

Hazan, Eric; Madgavkar, Anu; Chui, Michael; Smit, Sven; Maor, Dana; Dandona, Gurneet Singh; Huyghues-Despointes, Roland. (2024, Mai). A new future of work: The race to deploy AI and raise skills in Europe and beyond. McKensey Global Institute.

Jonker, Alexandra; Rogers, Julie. (2024, 20. September). Was ist algorithmische Verzerrung? IBM Deutschland.

Kolomaznik, Michal; Petrik, Vladimir; Slama, Michal; Jurik, Vojtech. (2024). The role of socio-emotional attributes in enhancing human-AI collaboration. In: Frontiers in Psychology, 15, 1369957.

Long, Duri; Magerko, Brian. (2020). What is AI literacy? Competencies and design considerations. In: Proceedings of the 2020 CHI Conference on Human Factors in Computing Systems, 1–16.

Nass, Clifford; Moon, Youngme. (2000). Machines and Mindlessness: Social Responses to Computers. In: Journal of Social Issues, 56(1), 81–103.

Observatorium Künstliche Intelligenz in Arbeit und Gesellschaft. (2024, 11. Dezember). Wie bereiten wir Mitarbeitende auf KI vor? – KI-Kompetenzen (AI Literacy) am Arbeitsplatz veranschaulichen, messen und fördern. Bundesministerium für Arbeit und Soziales, Abteilung D Denkfabrik Digitale Arbeitsgesellschaft.

Revollo Morales, Enrique. (2024). Algorithmische Verzerrung: Herausforderungen bewältigen. QuestionPro.

Wang, Bingcheng; Rau, Pei-Luen Patrick; Yuan, Tianyi. (2022). Measuring user competence in using artificial intelligence: Validity and reliability of artificial intelligence literacy scale. In: Behaviour & Information Technology, 42(9), 1324–1337.

AI for Education. (2024, 17. Oktober). Building Student AI Literacy [Video]. YouTube.

Diaz, Susan (Moderation). (2024, 24. Jänner). EP208 AI for All: Empowerment through AI Literacy and Learning [Podcast]. AI Literacy for Entrepreneurs.

Jones, Dan (Moderation). (2024, 10. September). 037: Leading with AI: transforming organisational culture – with Michael Molinaro [Podcast]. In Good Company with Impact.

Schmalzries, Gregor; Kilg, Marie; Espenlaub, Fritz (Moderation). (2024, 22. Oktober). Wie mache ich meinen Job zukunftssicher? [Podcast] Der KI-Podcast.

Turchin, Dan (Moderation). (2024, 7. Oktober). 305: Matt Beane, Author & Professor, On Mastering Skills To Stay Relevant In The Age of AI [Podcast]. AI and the Future of Work: Artificial Intelligence in the Workplace, Business, Ethics, HR, and IT for AI Enthusiasts, Leaders.

Wilson Jordan (Moderation). (2024, 17. Oktober). EP 382: Why AI Literacy is Essential for Parents and Kids in Education and Beyond [Podcast]. Everyday AI Podcast – An AI and ChatGPT Podcast.

Carola Zentara

Carola Zentara macht integriertes Marketing und strategische Projektführung zum Erfolgsmotor. Ihr Ansatz: Kanäle und Maßnahmen zu einem stimmigen Gesamtkonzept verbinden. Ihre Leidenschaft haben internationale Firmen und politische Kampagnen gleichermaßen geprägt. Digitale Welt? Ihr Spielplatz. Mut zu frischen Ideen? Ihr Geheimrezept.